DeepSeek-V4 & GPT-5.5 : L'IA ne vous oubliera plus jamais

Résumé de l'article

📖 9 min de lectureCet article explore le changement de paradigme apporté par le contexte d'un million de tokens de DeepSeek-V4 pour les agents autonomes, contrastant avec la consolidation des capacités de codage de GPT-5.5. Il souligne que le véritable gain réside dans l'élimination du coût de re-contextualisation, transformant radicalement les workflows basés sur l'IA.

Points clés :

- DeepSeek-V4 offre une fenêtre contextuelle d'un million de tokens, permettant aux agents IA de traiter l'équivalent de sept romans en une seule session.

- Cette capacité contextuelle massive élimine le besoin de re-contextualisation constante, réduisant la charge cognitive pour les utilisateurs d'IA.

- Les agents autonomes peuvent désormais ingérer des bases de code entières, des historiques de projets longs ou des documentations complètes sans perdre le fil.

- Pendant que DeepSeek-V4 innove sur le contexte, GPT-5.5 se concentre sur l'amélioration et la consolidation de ses capacités de codage.

- Le véritable impact de ces avancées réside dans la transformation des workflows concrets pour les développeurs, les freelances et les équipes qui s'appuient sur l'IA.

- L'élimination du coût de re-contextualisation est le gain fondamental, permettant une interaction plus fluide et efficace avec les intelligences artificielles.

Un million de tokens. Laissez ce chiffre faire son chemin.

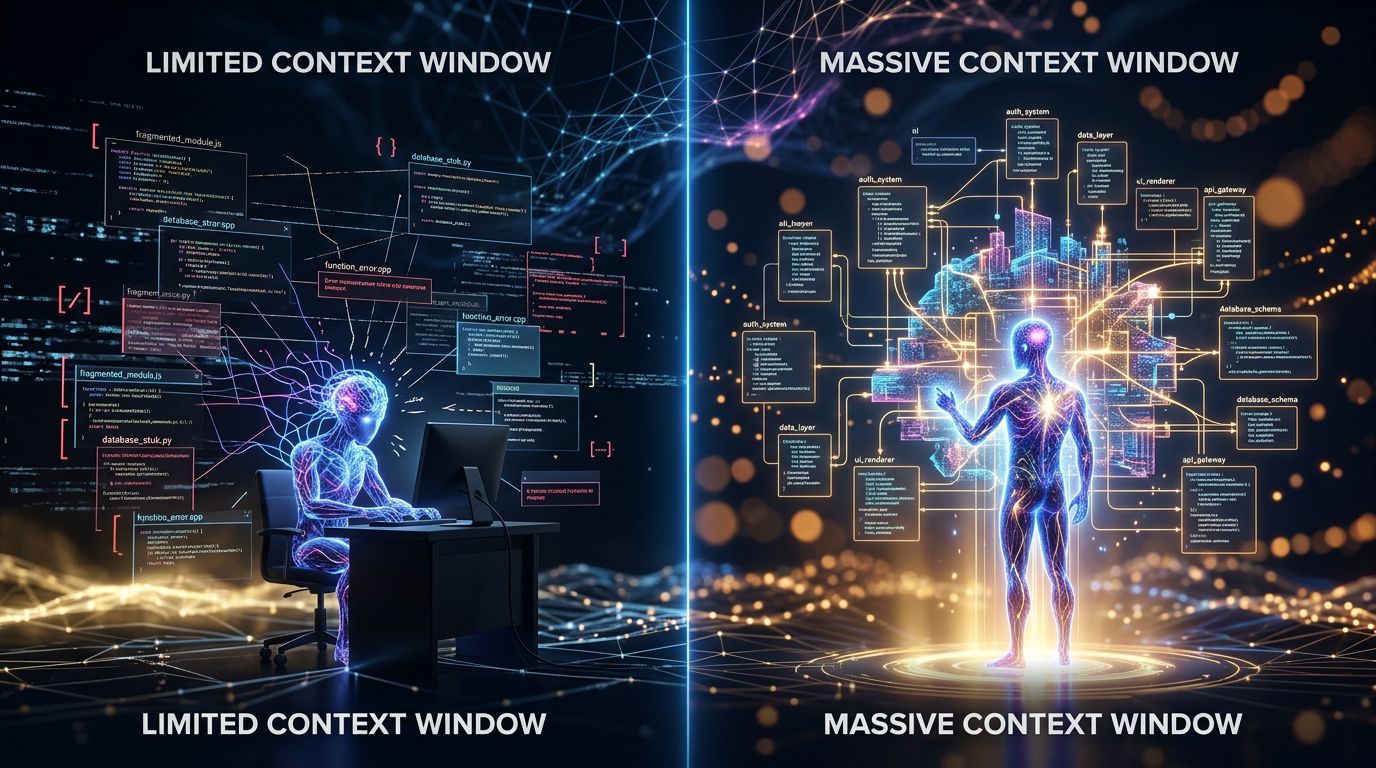

C’est la fenêtre contextuelle que DeepSeek-V4 embarque pour les agents autonomes. Un million de tokens, c’est environ 750 000 mots — soit l’équivalent de sept romans de taille moyenne que le modèle peut lire, analyser et raisonner en une seule session. Comparez ça aux 8 000 tokens des premiers GPT-4, et vous comprenez pourquoi on parle d’un changement de paradigme, pas d’une mise à jour de routine.

Pendant ce temps, OpenAI consolide ses capacités de codage dans GPT-5.5. Pas un nouveau modèle de rupture — une consolidation. Et c’est précisément là que l’analyse devient intéressante. Parce que pendant que tout le monde regarde les benchmarks, les vrais enjeux se jouent ailleurs : dans la façon dont ces modèles vont transformer les workflows concrets des développeurs, des freelances et des équipes qui comptent sur l’IA au quotidien.

Ce que “contexte massif” veut vraiment dire sur le terrain

Voici où ça devient croustillant. La plupart des articles sur DeepSeek-V4 s’arrêtent au chiffre. Un million de tokens, wow, impressionnant, passons à la suite. Ce qu’on ne vous dit jamais, c’est ce que ça change concrètement dans un workflow d’agent autonome.

Un agent IA avec 8 000 tokens de contexte, c’est comme un consultant qui lit la première page de chaque document avant votre réunion. Il peut faire semblant de suivre, mais dès que vous creusez, il perd le fil. Vous devez re-expliquer. Re-contextualiser. Compenser son amnésie par votre propre charge cognitive.

Un agent avec un million de tokens de contexte, c’est différent. Il peut ingérer l’intégralité d’une codebase de taille moyenne, tous les échanges d’un projet sur six mois, la documentation complète d’une API, et encore avoir de la marge. Il ne perd pas le fil — parce qu’il n’y a pas de fil à perdre. Le contexte est là, entier, disponible.

Le vrai gain n’est pas la mémoire. C’est l’élimination du coût de re-contextualisation.

GPT-5.5 et le codage : la consolidation comme stratégie

Retournons la situation sur OpenAI. Tout le monde attendait une révolution, ils ont livré une consolidation. Première réaction : déception. Deuxième réaction, après réflexion : c’est peut-être plus malin.

GPT-5.5 ne cherche pas à réinventer le codage IA. Il cherche à le fiabiliser. La différence est fondamentale. Les modèles de codage précédents pouvaient produire du code brillant dans 80% des cas et du code catastrophiquement faux dans les 20% restants — sans que vous sachiez distinguer les deux avant d’avoir testé. Cette variance est le vrai problème en production.

Ce qu’on observe avec GPT-5.5, c’est une réduction de cette variance. Moins de hallucinations sur les APIs. Meilleure cohérence sur des tâches de refactoring longues. Complétion plus fiable sur des patterns complexes. Ce n’est pas spectaculaire à démontrer dans une démo YouTube. C’est critique pour un développeur qui ship en production.

Mon analyse révèle une tendance de fond : les labs IA ont compris que leurs utilisateurs professionnels ne cherchent plus des modèles qui impressionnent — ils cherchent des modèles sur lesquels ils peuvent compter. La fiabilité est le nouveau benchmark.

“The best tool is not the most powerful one. It’s the one you can trust.” — principe de base en ingénierie logicielle, plus vrai que jamais appliqué à l’IA.

Agents autonomes : ce que les contextes massifs débloquent vraiment

L’expérience m’a appris que les agents IA échouent rarement sur des tâches isolées. Ils échouent sur la coordination. Sur le maintien de cohérence entre des décisions prises à différents moments d’un workflow long. Sur la capacité à “se souvenir” que la décision prise à l’étape 3 a des implications sur ce qu’on fait à l’étape 47.

DeepSeek-V4 s’attaque directement à ce problème. Avec un million de tokens disponibles, un agent peut maintenir une représentation cohérente d’un projet complexe du début à la fin — sans avoir à compresser, résumer ou tronquer l’historique des décisions. Ce n’est pas un détail technique. C’est la différence entre un agent qui exécute des tâches et un agent qui gère un projet.

Trois cas d’usage qui deviennent réalistes avec ce niveau de contexte :

- Refactoring de codebase entière : l’agent voit toutes les dépendances, tous les patterns, toutes les décisions architecturales en simultané. Plus de refactoring partiel qui casse ce qu’il ne voyait pas.

- Analyse de contrats et due diligence : ingérer 500 pages de documents légaux, identifier les contradictions, les clauses à risque, les incohérences — en une seule passe.

- Gestion de projet longue durée : un agent qui suit un projet sur plusieurs semaines sans perdre le contexte des décisions initiales.

Ce que ça change pour les freelances et les équipes

Voyons ça sous un autre angle. Ces avancées ne sont pas que des nouvelles pour les chercheurs en ML ou les ingénieurs de Google. Elles ont des implications directes pour quiconque utilise l’IA comme outil de travail quotidien.

Pour le freelance qui gère dix clients en parallèle, l’enjeu n’est pas la puissance brute du modèle — c’est la capacité de l’IA à maintenir un contexte séparé et cohérent pour chaque client, sans confusion, sans réinitialisation. Les contextes massifs permettent des architectures mémoire plus sophistiquées. Des systèmes comme pgvector couplés à des modèles à large contexte peuvent maintenir une représentation riche de chaque relation client — historique complet, préférences, projets en cours, décisions passées.

Pour une agence qui gère des campagnes complexes, la capacité à faire analyser l’intégralité d’un brief, de tous les assets existants et de l’historique des performances par un seul agent cohérent — sans découpage artificiel — change la qualité des outputs.

Pour les développeurs solo ou en petite équipe, GPT-5.5 consolidé signifie moins de temps passé à vérifier et corriger le code généré. Si le modèle est 20% plus fiable sur les patterns complexes, c’est 20% de temps de review économisé. Sur une semaine de 40h, ça se mesure.

Ce qu’on ne vous dit jamais dans les annonces de nouveaux modèles : le vrai ROI n’est pas dans la performance peak. Il est dans la réduction de la friction quotidienne.

Le vrai défi : intégration, pas adoption

Mais attention au piège. La disponibilité d’un modèle à un million de tokens ne résout pas magiquement les problèmes d’intégration. Un contexte massif non structuré reste un contexte massif non structuré. Donner à un agent accès à un million de tokens de données non organisées, c’est comme donner à un consultant accès à une salle entière de classeurs sans index.

La vraie compétence qui émerge ici, c’est l’architecture de contexte. Comment structurer l’information pour que l’agent puisse la naviguer efficacement ? Comment prioriser ce qui doit être en contexte actif versus ce qui peut être récupéré via recherche sémantique ? Comment éviter la dilution de signal dans le bruit quand la fenêtre est massivement large ?

Ces questions sont techniques, mais elles ont des réponses pratiques. Les stacks qui combinent un large contexte natif (pour la cohérence de raisonnement) avec une récupération vectorielle précise (pour la pertinence) commencent à montrer des résultats mesurables. Ce n’est plus de la recherche — c’est de l’ingénierie de workflow.

“Un outil n’est puissant que si vous savez comment l’intégrer.” — évidence que l’industrie IA redécouvre à chaque génération de modèles.

Trois insights actionnables à retenir

1. Évaluez vos workflows sur le critère de la re-contextualisation. Combien de temps passez-vous chaque semaine à ré-expliquer le contexte à votre IA ? Si la réponse dépasse 30 minutes, vous avez un problème d’architecture, pas un problème de modèle.

2. La fiabilité avant la puissance. Pour les cas d’usage en production — code, contrats, communications client — choisissez le modèle le plus fiable, pas le plus impressionnant sur les benchmarks. GPT-5.5 consolidé peut battre un modèle plus “puissant” si sa variance est plus faible.

3. Commencez à penser en termes d’agents, pas d’assistants. La différence : un assistant répond à vos questions. Un agent prend des initiatives, maintient un objectif sur la durée, et gère la complexité sans intervention constante. Les contextes massifs rendent cette distinction concrète pour la première fois.

La mémoire n’est plus un luxe

Impact. C’est le mot juste pour résumer ce que DeepSeek-V4 et GPT-5.5 signalent ensemble.

L’ère de l’IA sans mémoire — celle où vous re-expliquiez vos clients à chaque session, où vous découpiez artificiellement vos projets pour tenir dans la fenêtre contextuelle, où vous compensiez l’amnésie du modèle par votre propre surcharge cognitive — cette ère se termine. Pas dans cinq ans. Maintenant.

Ce qui reste à construire, c’est l’infrastructure qui exploite vraiment ces capacités. Des systèmes avec mémoire persistante, contexte structuré, agents qui travaillent en arrière-plan et rendent compte quand c’est pertinent. Des outils qui connaissent vos clients aussi bien que vous — et qui ne réinitialisent pas cette connaissance à chaque conversation.

C’est exactement ce sur quoi nous travaillons avec Nova-Mind. Mémoire permanente via pgvector, agents proactifs, contexte client qui persiste et s’enrichit dans le temps. Si vous êtes freelance, solopreneur ou en petite agence et que vous en avez assez de gérer l’amnésie de vos outils IA, c’est le bon moment pour tester. Les modèles sont enfin à la hauteur. L’infrastructure aussi.

La question n’est plus “est-ce que l’IA peut s’en souvenir ?” La question est “avez-vous un système qui lui permet de le faire ?”