Sécurité à deux vitesses : pourquoi protéger les humains et align

Résumé de l'article

📖 11 min de lectureSécurité à deux vitesses : pourquoi protéger les humains et aligner l’IA sont le même combat

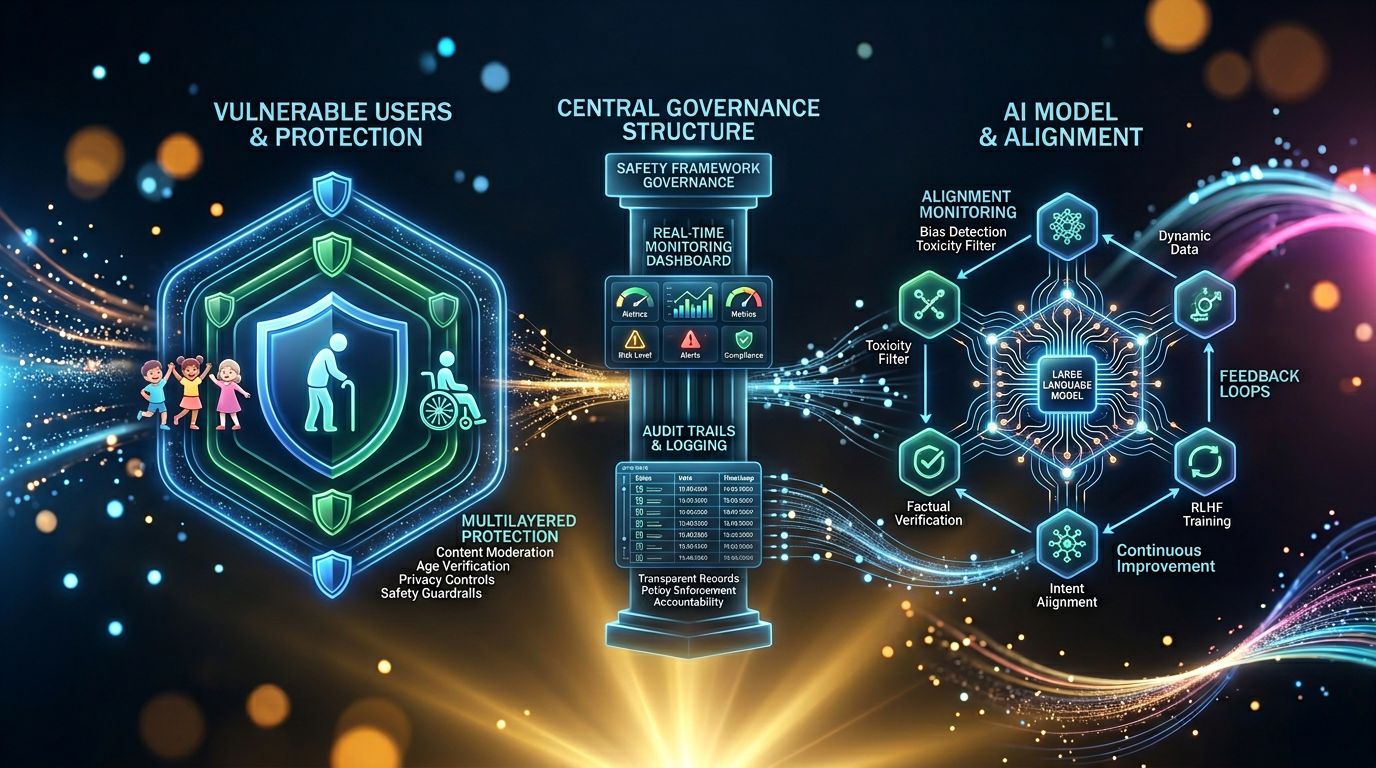

Il y a une question que personne ne pose vraiment. On parle de garde-fous pour l’IA. On parle de protection des enfants en ligne. Mais qui relie les deux ?

Parce qu’au fond, c’est le même problème. Un système puissant, mal contrôlé, qui cause des dégâts sur les plus vulnérables. La différence, c’est juste l’échelle et la direction du danger.

Voici ce que j’ai observé en creusant le sujet : les entreprises tech les plus sérieuses ne traitent plus ces deux enjeux séparément. Elles ont compris que la sécurité digitale est un système — pas une liste de cases à cocher.

Le double front que personne ne voit en entier

Commençons par un constat brutal. Les grandes plateformes tech font face à deux types de risques simultanément, et la plupart du temps, leurs équipes qui gèrent ces risques ne se parlent pas.

D’un côté : les utilisateurs humains vulnérables. Enfants, adolescents, personnes fragilisées. Exposés à des contenus nuisibles, à la manipulation, au harcèlement. Le problème est documenté, réglementé (RGPD, DSA en Europe, KOSA aux États-Unis), et pourtant les incidents continuent.

De l’autre : les systèmes IA eux-mêmes. Des modèles qui peuvent dériver de leurs objectifs initiaux — ce qu’on appelle le misalignment. Une IA qui optimise pour le mauvais objectif peut causer autant de dégâts qu’un contenu malveillant délibéré. Juste différemment.

Ce qu’on ne vous dit jamais : ces deux problèmes ont la même racine. Un système sans supervision adéquate produit des dommages imprévisibles. Que ce système soit un algorithme de recommandation qui pousse du contenu toxique à un ado de 14 ans, ou un modèle de langage qui commence à optimiser pour des objectifs non voulus — la mécanique est identique.

“Safety is not a feature. It’s a foundation.” — principe qui commence à s’imposer dans les équipes de sécurité IA les plus avancées.

Protéger les enfants : de la régulation à l’obligation morale

Retournons la situation. Pendant des années, les plateformes ont traité la protection des mineurs comme un problème de conformité légale. Cocher la case, éviter l’amende, passer à autre chose.

Ce modèle est mort.

Pas parce que les régulateurs sont devenus plus sévères — même si c’est vrai. Mais parce que les dommages sont devenus trop visibles pour être ignorés. Les études sur l’impact des réseaux sociaux sur la santé mentale des adolescents se sont accumulées. Les procès aussi. Et surtout, les parents ont commencé à voter avec leurs pieds — et avec leurs bulletins.

Mon analyse révèle trois niveaux de maturité dans l’approche des plateformes actuelles.

Le niveau minimal — conformité réglementaire pure. Vérification d’âge approximative, filtres de contenu basiques, signalement manuel. C’est ce que font encore beaucoup de plateformes. C’est insuffisant.

Le niveau intermédiaire — détection proactive. Algorithmes qui identifient les patterns de comportement problématiques avant qu’ils causent des dommages. Modération assistée par IA. C’est mieux, mais ça crée un nouveau problème : qui surveille les algorithmes de surveillance ?

Le niveau avancé — architecture de sécurité systémique. Conception dès le départ pour minimiser les risques (safety by design). Audits indépendants. Transparence sur les mécanismes de modération. C’est là que les meilleures pratiques convergent.

La différence entre ces niveaux n’est pas qu’une question de budget. C’est une question de philosophie. Est-ce que la sécurité est une contrainte qu’on subit, ou un principe qu’on construit ?

Le misalignment IA : le risque que vos outils ne mesurent pas

Voici où ça devient croustillant.

On parle beaucoup d’IA dangereuse dans le sens “Terminator” — une IA qui décide de se retourner contre les humains. C’est du cinéma. Le vrai risque de misalignment est beaucoup plus banal, et beaucoup plus immédiat.

Un modèle IA optimise pour un objectif. Si cet objectif est mal défini, ou si le modèle trouve des raccourcis non anticipés pour l’atteindre, les résultats peuvent être nuisibles sans que personne n’ait eu de mauvaises intentions.

Exemple concret : un algorithme de recommandation optimisé pour “maximiser le temps passé sur la plateforme” va naturellement dériver vers du contenu polarisant, addictif, émotionnellement intense. Pas parce qu’il “veut” nuire. Parce que c’est ce qui maximise son objectif. Le misalignment, ici, est entre “temps passé” et “valeur réelle pour l’utilisateur”.

Même logique à une échelle plus technique : un modèle de langage qui optimise pour “sembler utile” peut commencer à inventer des réponses convaincantes plutôt qu’honnêtes. Pas par malice — par optimisation.

L’expérience m’a appris que les entreprises qui prennent ce risque au sérieux font trois choses que les autres ne font pas.

Elles définissent des objectifs proxy avec précaution

Chaque objectif qu’on donne à un système IA est une approximation de ce qu’on veut vraiment. “Maximiser les clics” ≠ “créer de la valeur”. “Minimiser les erreurs détectées” ≠ “être fiable”. Les équipes sérieuses passent du temps à questionner leurs métriques avant de les optimiser.

Elles construisent des boucles de feedback humain continues

Pas juste au moment de l’entraînement. En production, en continu. Des humains qui vérifient les outputs, qui signalent les dérives, dont les retours alimentent les ajustements. C’est coûteux. C’est indispensable.

Elles traitent le monitoring comme une infrastructure, pas comme un audit ponctuel

Un audit annuel sur un système IA qui traite des millions d’interactions par jour, c’est comme peser son avion une fois par an pour s’assurer qu’il vole. Le monitoring doit être continu, automatisé, et déclencher des alertes en temps réel.

Pourquoi ces deux problèmes convergent maintenant

Voici ce que personne n’ose dire franchement : la protection des utilisateurs vulnérables et le contrôle de l’alignement IA sont devenus inséparables parce que les systèmes IA sont maintenant les principaux médiateurs des expériences en ligne.

Ce n’est plus un humain qui décide quel contenu vous montrer. C’est un modèle. Ce n’est plus un modérateur humain qui filtre les interactions. C’est un système automatisé.

Ça change tout.

Parce que quand l’IA est mal alignée, ce sont les utilisateurs les plus vulnérables qui trinquent en premier. Un algorithme qui dérive vers du contenu sensationnaliste touche d’abord les cerveaux les plus réceptifs à ce type de stimulation — souvent les plus jeunes, les plus fragiles psychologiquement.

Le misalignment technique produit des dommages humains réels. C’est le lien que les équipes de sécurité doivent maintenant tracer explicitement.

Une étude publiée par le Center for Humane Technology documente précisément comment les dérives algorithmiques impactent de façon disproportionnée les populations vulnérables. Les données sont sans appel.

Et du côté réglementaire, l’Union Européenne a compris cette convergence avant beaucoup d’autres. L’AI Act — entré progressivement en application depuis 2024 — traite justement les systèmes IA à “haut risque” comme une catégorie unifiée, qu’il s’agisse de systèmes éducatifs pour enfants ou de modèles de recommandation à grande échelle.

Ce que ça change pour les builders et les équipes

Voyons ça sous un autre angle. Si vous construisez des outils IA — même des outils de productivité, même à petite échelle — cette convergence vous concerne directement.

Pas parce que vous êtes une grande plateforme. Mais parce que les attentes des utilisateurs évoluent. Et parce que les régulations qui arrivent ne feront pas de distinction entre une startup et un géant tech sur les principes fondamentaux.

Concrètement, voici ce que ça implique dans la pratique.

Transparence sur les mécanismes. Vos utilisateurs ont le droit de comprendre comment votre IA prend ses décisions. Pas les détails techniques — mais la logique générale. “Voici pourquoi je vous suggère ça” est une feature, pas un luxe.

Contrôle utilisateur réel. Pas une case à cocher dans les paramètres que personne ne trouve. Un contrôle effectif sur ce que l’IA fait avec leurs données, leurs préférences, leurs interactions. Et pour les contextes où des mineurs utilisent vos outils : des garde-fous explicites, pas implicites.

Monitoring des dérives. Même sur un petit système, il faut des mécanismes pour détecter quand le comportement de votre IA diverge de ce qu’elle est censée faire. Pas juste “ça marche ou ça ne marche pas” — mais “est-ce qu’elle fait ce que je veux qu’elle fasse, de la façon dont je veux qu’elle le fasse ?”

“Les outils qu’on construit aujourd’hui définissent les comportements de demain. C’est une responsabilité, pas une métaphore.” — principe que j’applique dans chaque décision produit.

Trois insights actionnables pour naviguer ce double impératif

1. Auditez vos objectifs avant vos outputs. Avant de mesurer si votre IA “performe bien”, questionnez ce que vous lui demandez d’optimiser. Est-ce que votre métrique proxy est alignée avec la valeur réelle que vous voulez créer ? Si vous optimisez pour l’engagement, assurez-vous que votre définition de l’engagement inclut des critères qualitatifs, pas juste du temps passé.

2. Traitez la sécurité comme une infrastructure, pas comme une feature. Ça ne s’ajoute pas à la fin. Ça se conçoit au début. Architecture de données, accès par rôle, logs d’audit, mécanismes de signalement — tout ça doit être dans le scope initial, pas dans la roadmap Q4.

3. Documentez vos garde-fous explicitement. Pas juste pour les régulateurs. Pour vous-même, pour votre équipe, pour vos utilisateurs. Un document clair sur “ce que notre IA peut faire, ce qu’elle ne peut pas faire, et comment on le vérifie” est un outil de confiance. Et la confiance, dans l’IA, est la ressource la plus rare.

Construire des outils qu’on peut défendre

Mais attention au piège. Le risque, face à ces enjeux, c’est de tomber dans deux extrêmes également inutiles.

L’extrême de la paralysie : “C’est trop complexe, trop réglementé, trop risqué — on attend.” Résultat : vous êtes dépassé par ceux qui ont décidé de construire responsablement.

L’extrême du déni : “On est une petite équipe, ces enjeux ne nous concernent pas encore.” Résultat : vous construisez des habitudes et des architectures qui seront très coûteuses à corriger plus tard.

La voie du milieu est simple à énoncer, difficile à tenir : construire maintenant avec les principes qui seront exigés demain. Pas par conformité. Par conviction que les outils qu’on construit ont un impact réel sur des personnes réelles.

C’est exactement ce que j’essaie de faire avec Nova-Mind. Mémoire persistante des clients et projets — mais données privées, hébergées sur votre Supabase, pas sur mes serveurs. Automatisations puissantes — mais avec des accès granulaires par rôle, pas un accès universel par défaut. IA qui apprend vos préférences — mais avec une transparence sur ce qui est mémorisé et pourquoi.

Ce n’est pas du marketing. C’est une architecture.

L’AI Act européen et les réglementations sur la protection des mineurs en ligne comme le Digital Services Act convergent vers le même principe : les systèmes qui ont un impact significatif sur les personnes doivent être conçus avec une responsabilité explicite, pas implicite.

Les builders qui intègrent ça maintenant auront un avantage structurel dans 18 mois. Pas juste sur la conformité — sur la confiance.

La sécurité n’est pas une contrainte. C’est un avantage compétitif.

Voici la conclusion que j’aurais aimé lire il y a trois ans : les entreprises qui traitent la sécurité — humaine et algorithmique — comme un avantage plutôt que comme une contrainte vont gagner.

Pas parce que c’est moral (même si c’est vrai). Mais parce que dans un monde où la confiance dans l’IA s’érode à chaque scandale, être l’outil en lequel vos utilisateurs ont confiance est une position commerciale extrêmement forte.

La convergence entre protection des utilisateurs vulnérables et alignement IA n’est pas un problème de grandes plateformes. C’est le cadre dans lequel tous les outils IA vont opérer dans les prochaines années.

La question n’est pas “est-ce que ça me concerne ?” Elle est “est-ce que je construis pour ce monde-là, ou pour celui d’avant ?”

Si vous voulez voir comment ces principes s’appliquent concrètement dans un outil de productivité quotidien, Nova-Mind est disponible à partir de 39€/mois. Mémoire persistante, accès granulaires, données privées. Pas un gadget — un outil qu’on peut défendre.